Deux mois après que Nvidia et OpenAI ont révélé leur projet surprenant de déployer au moins 10 gigawatts de systèmes Nvidia (et jusqu’à 100 milliards de dollars d’investissements), le fabricant de puces admet désormais que l’accord n’est pas vraiment définitif.

S’exprimant mardi lors de la conférence UBS Global Technology and AI à Scottsdale, en Arizona, la vice-présidente exécutive et directrice financière de Nvidia, Colette Kress, a déclaré aux investisseurs que le très médiatisé partenariat OpenAI en était encore au stade de la lettre d’intention.

“Nous n’avons pas encore conclu d’accord définitif”, a déclaré Kress lorsqu’on lui a demandé quelle part de l’engagement de 10 gigawatts était réellement assurée.

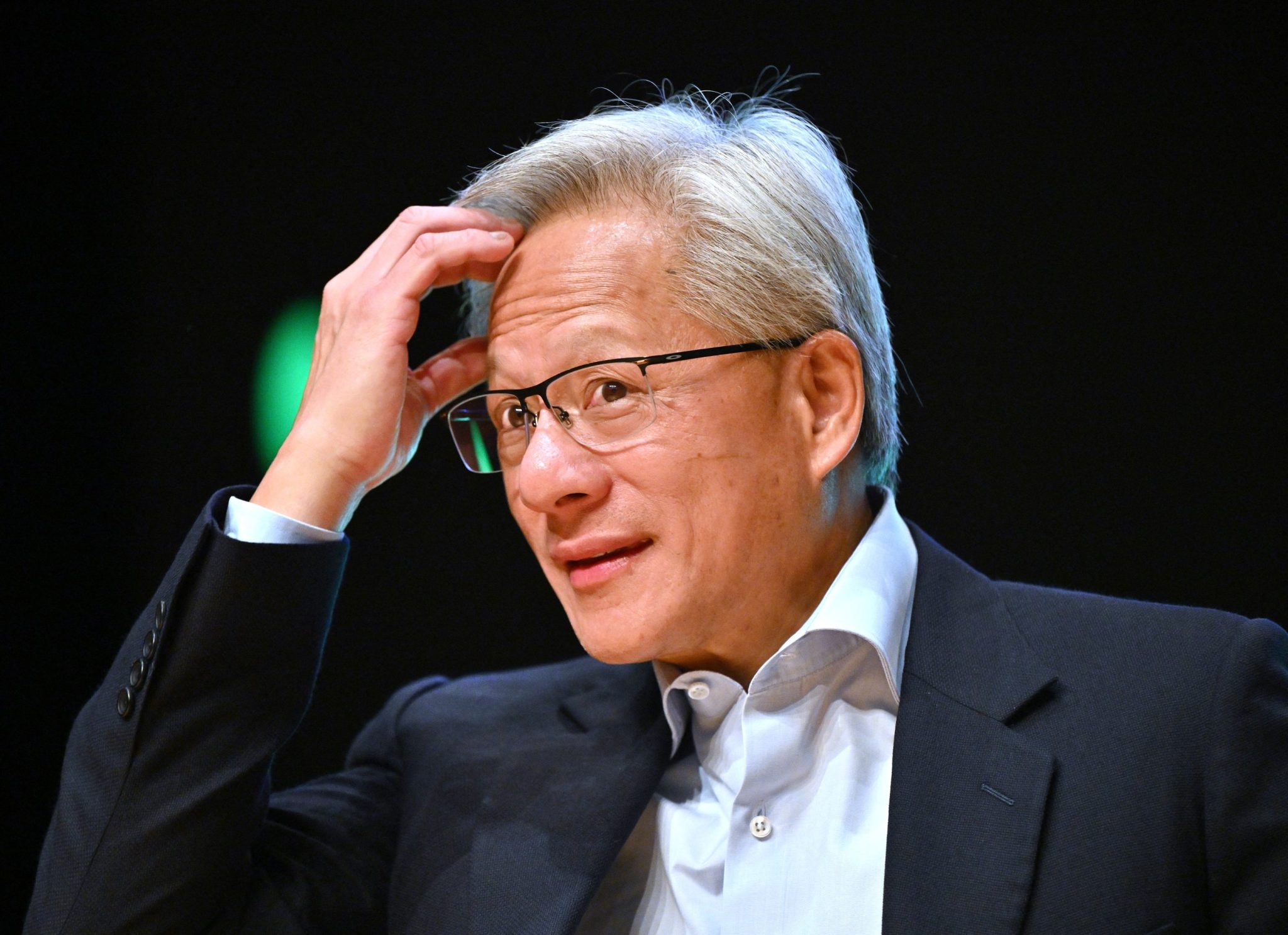

Il s’agit d’une clarification surprenante pour un accord que le PDG de Nvidia, Jensen Huang, a qualifié un jour de “plus grand projet d’infrastructure d’IA de l’histoire”. Les analystes avaient estimé que l’accord pourrait générer jusqu’à 500 milliards de dollars de revenus pour le fabricant de puces IA.

Les commentaires de Kress suggèrent quelque chose de plus provisoire, même des mois après la publication du cadre.

Un méga accord qui ne se chiffre pas encore

On ne sait pas pourquoi l’accord n’a pas été exécuté, mais le dernier 10-Q de Nvidia offre des indices. Le dossier indique clairement qu ‘”il n’y a aucune garantie qu’un investissement sera réalisé dans les conditions prévues, voire pas du tout”, faisant référence non seulement à l’accord OpenAI mais également à l’investissement prévu de 10 milliards de dollars par Nvidia dans Anthropic et à son engagement de 5 milliards de dollars envers Intel.

Dans une longue section sur les « Facteurs de risque », Nvidia explique l’architecture fragile qui sous-tend de mégatransactions comme celle-ci. L’entreprise souligne que l’histoire est aussi réelle que la capacité du monde à construire et à alimenter les centres de données nécessaires au fonctionnement de ses systèmes. Nvidia doit commander des GPU, de la mémoire HBM, des équipements réseau et d’autres composants plus d’un an à l’avance, souvent via des contrats prépayés non résiliables. Si les clients réduisent, retardent le financement ou changent d’adresse, Nvidia prévient qu’ils pourraient se retrouver avec des « stocks excédentaires », des « pénalités d’annulation » ou des « provisions ou dépréciations de stocks ». Les inadéquations passées entre l’offre et la demande ont « considérablement nui à nos résultats financiers », note le document.

Le plus grand facteur de basculement semble être le monde physique : Nvidia affirme que la disponibilité de « la capacité, de la puissance et du capital du centre de données » est essentielle pour que les clients puissent déployer les systèmes d’IA pour lesquels ils se sont verbalement engagés. Le développement énergétique est décrit comme un « processus pluriannuel » confronté à des « défis réglementaires, techniques et de construction ». Si les clients ne peuvent pas obtenir suffisamment d’électricité ou de financement, prévient Nvidia, cela pourrait « retarder les déploiements des clients ou réduire l’ampleur » de l’adoption de l’IA.

Nvidia admet également que son propre rythme d’innovation rend la planification difficile. Elle a évolué vers une cadence annuelle de nouvelles architectures (Hopper, Blackwell, Vera Rubin) tout en continuant à accompagner les générations précédentes. Il note qu’un rythme plus rapide de l’architecture « peut amplifier les défis » liés à la prévision de la demande et conduire à une « demande réduite pour les produits de la génération actuelle ».

Ces aveux font référence aux avertissements des ours de l’IA comme Michael Burry, l’investisseur de « The Big Short », qui a allégué que Nvidia et d’autres fabricants de puces prolongent excessivement la durée de vie de leurs puces et qu’une éventuelle dépréciation des puces entraînerait des perturbations dans le cycle d’investissement. Cependant, Huang a déclaré que les puces d’il y a six ans fonctionnaient toujours à plein régime.

La société a également explicitement fait un clin d’œil aux cycles d’expansion et de récession passés liés à des cas d’utilisation « chauds » comme l’extraction de crypto-monnaie, avertissant que les nouvelles charges de travail d’IA pourraient créer des pics et des ralentissements similaires, difficiles à prévoir et susceptibles d’inonder le marché gris de GPU d’occasion.

Malgré l’absence d’accord, Kress a souligné que la relation entre Nvidia et OpenAI reste « un partenariat très solide », vieux de plus de dix ans. OpenAI, a-t-il déclaré, considère Nvidia comme son « partenaire privilégié » pour l’informatique. Mais il a ajouté que les perspectives de ventes actuelles de Nvidia ne dépendent pas du nouveau méga-accord.

Le procès d’environ 500 milliards de dollars contre Blackwell et Vera Rubin que Nvidia a mené pour 2025-2026 “n’inclut aucun des travaux que nous effectuons actuellement sur la prochaine partie de l’accord avec OpenAI”, a-t-il déclaré. Pour l’instant, les achats d’OpenAI transitent indirectement par l’intermédiaire de partenaires cloud comme Microsoft et Oracle plutôt que par le biais du nouvel accord direct énoncé dans la lettre d’intention.

OpenAI « veut être direct », a déclaré Kress. “Mais encore une fois, nous travaillons toujours sur un accord final.”

Nvidia insiste sur le fait que les douves sont intactes

Sur la dynamique concurrentielle, Kress s’est montré sans équivoque. Dernièrement, les marchés ont applaudi le TPU de Google, qui a un cas d’utilisation plus petit que le GPU mais nécessite moins d’énergie, en tant que concurrent potentiel du GPU de NVIDIA. Lorsqu’on lui a demandé si ces types de puces, appelés ASICS, réduisaient l’avance de Nvidia, il a répondu : “Bien sûr que non”.

“Notre objectif à l’heure actuelle est d’aider tous les différents créateurs de modèles, mais également d’aider de nombreuses entreprises disposant d’une solution complète”, a-t-il déclaré. Le fossé défensif de Nvidia, a-t-il soutenu, n’est pas une puce individuelle mais la plate-forme entière : le matériel, CUDA et une bibliothèque en constante expansion de logiciels spécifiques à l’industrie. Cette pile, a-t-il déclaré, est la raison pour laquelle les anciennes architectures restent largement utilisées même si Blackwell devient la nouvelle norme.

“Ils sont tous sur notre plateforme”, a déclaré Kress. “Tous les modèles sont sur notre plateforme, à la fois dans le cloud et sur site.”